周鴻祎:人工智能最后的底線必須是人

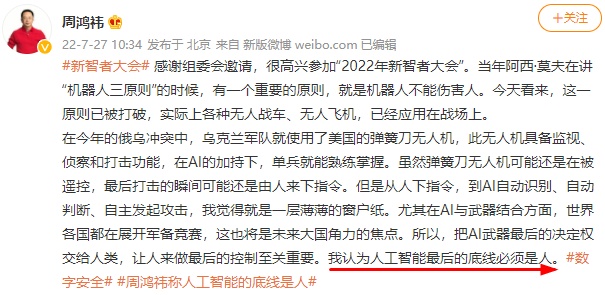

7月27日消息,今日,2022年新智者大會正式啟幕,360集團創始人周鴻祎在其官方微博發文感謝組委會邀請,并表達自己對AI武器的看法。

周鴻祎稱,當年阿西·莫夫在講“機器人三原則”的時,有一個重要的原則,就是機器人不能傷害人。他表示,這一原則如今已被打破,實際上各種無人戰車、無人飛機,已經應用在戰場上。

周鴻祎表示,在今年的俄烏沖突中,烏克蘭軍隊使用美國的彈簧刀無人機,此無人機具備監視、偵察和打擊功能,在AI的加持下,單兵就能熟練掌握。雖然彈簧刀無人機可能還是在被遙控,最后打擊的瞬間可能還是由人來下指令。他表示,從人下指令,到AI自動識別、自動判斷、自主發起攻擊,就是一層薄薄的窗戶紙,尤其在AI與武器結合方面,世界各國都在展開軍備競賽,這也將是未來大國角力的焦點。“把AI武器最后的決定權交給人類,讓人來做最后的控制至關重要,人工智能最后的底線必須是人。”周鴻祎稱。

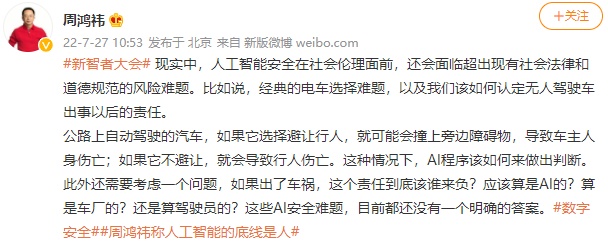

現實中,人工智能安全在社會倫理面前,還會面臨超出現有社會法律和道德規范的風險難題。比如說,經典的電車選擇難題,以及我們該如何認定無人駕駛車出事以后的責任。

公路上自動駕駛的汽車,如果它選擇避讓行人,就可能會撞上旁邊障礙物,導致車主人身傷亡;如果它不避讓,就會導致行人傷亡。這種情況下,AI程序該如何來做出判斷。此外還需要考慮一個問題,如果出了車禍,這個責任到底該誰來負?應該算是AI的?算是車廠的?還是算駕駛員的?這些AI安全難題,目前都還沒有一個明確的答案。

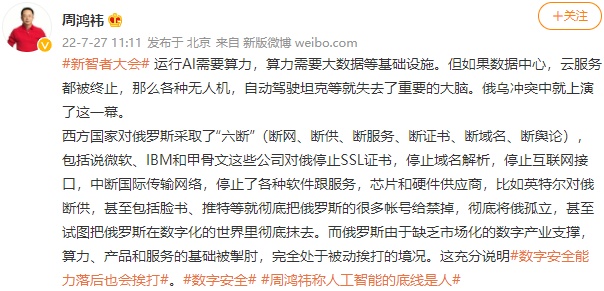

運行AI需要算力,算力需要大數據等基礎設施。但如果數據中心,云服務都被終止,那么各種無人機,自動駕駛坦克等就失去了重要的大腦。俄烏沖突中就上演了這一幕。

西方國家對俄羅斯采取了“六斷”(斷網、斷供、斷服務、斷證書、斷域名、斷輿論),包括說微軟、IBM和甲骨文這些公司對俄停止SSL證書,停止域名解析,停止互聯網接口,中斷國際傳輸網絡,停止了各種軟件跟服務,芯片和硬件供應商,比如英特爾對俄斷供,甚至包括臉書、推特等就徹底把俄羅斯的很多帳號給禁掉,徹底將俄孤立,甚至試圖把俄羅斯在數字化的世界里徹底抹去。而俄羅斯由于缺乏市場化的數字產業支撐,算力、產品和服務的基礎被掣肘,完全處于被動挨打的境況。這充分說明數字安全能力落后也會挨打。

人工智能安全問題也是其發展中面臨的重要挑戰,其中AI算法可能被欺騙、被誤導。谷歌曾經有一個AI算法,把黑人識別成“猩猩”,惹出很大風波。現在一些人工智能漏洞挖掘團隊還發現:當人走在街上,面對滿大街能夠進行人臉識別的人工智能攝像頭,只要穿上特殊條紋或者特殊圖案的T恤,攝像頭就會認為你不是一個人,也不會對你做面部識別,從而令你實現科幻小說所提的“隱身”效果。

360是一直高度重視人工智能安全的,并構建起人工智能安全能力體系。其中,360對自身積累的全球最大的安全大數據進行AI分析,形成了360云端安全大腦原型,為行業或企業提供強大的數據和情報支撐,對網絡威脅進行有效分析、溯源;同時積極承擔“安全大腦國家新一代人工智能開放創新平臺”的建設;此外還牽頭研發的“人工智能安全測評與風險監測預警平臺”入選工信部“人工智能產業創新任務揭榜單位”名單。盡管如此,面對諸多的人工智能安全問題,僅靠一家企業不能解決所有威脅,所以注重生態合作很重要。我們愿意開放自身安全大數據,將產學研力量聯合起來,共建AI安全生態,集中推動數字安全的創新。